9-1 오늘은 CNN 구조에 대해 알아보겠습니다.

9-2 AlexNet, VGG, GoogLeNet, ResNet에 대해 알아보고 다른 CNN 구조에 대해서도 알아보겠습니다.

9-3 Lenet-5은 산업에 성공적으로 적용된 최초의 conv모델입니다. 숫자인식에서 크게성공하여 우체국 산업에서 적용되었습니다.

9-4 Subsampling에서 Average pooling을 썻으며 non overlapping polling이 적용되었습니다. non overlapping polling이란 필터의 크기와 stride의 크기가 같아 중복되지 않고 polling하는 기법입니다. 자세한건 LeNet-5구현을 참조하시기

바랍니다.

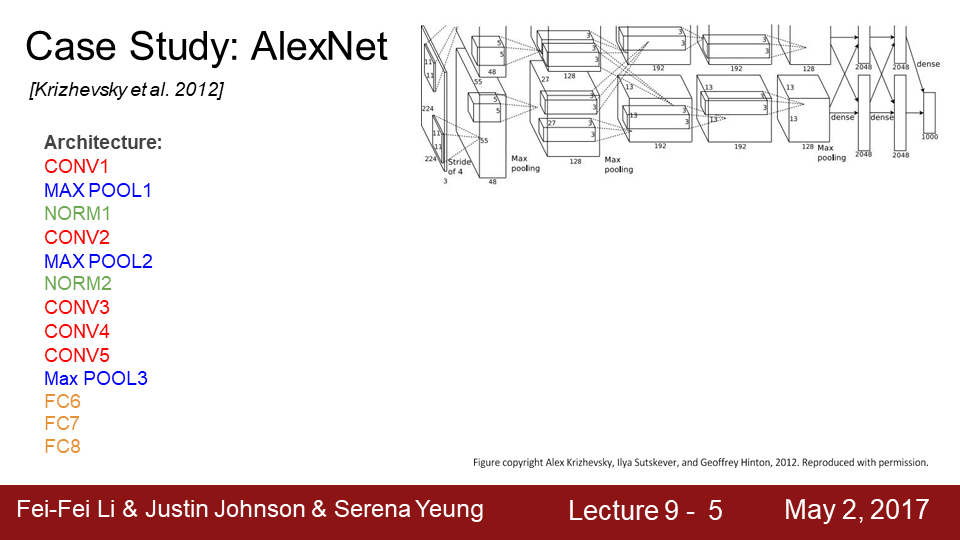

9-5 이번에는 AlexNet에 대하여 알아보겠습니다. AlexNet 12년에 등장해서 딥러닝을 부흥시켰습니다. 그이유는

최초로 ImageNet대회에서 CNN으로 우승했기 때문입니다. 구조는 LeNet-5와 비슷하고 레이어만 증가했습니다.

9-6 227x227x3 이미지에 11x11사이즈에 stride가4인 96개의 필터를 적용하면 output volume 사이즈는 어떻게 될까요? 먼저 높이와 너비의 계산 공식은 (전체 이미지 크기- 필터크기 + 2*padding size) / stride+1입니다.

9-7 정답은 55x55x96(필터갯수) 입니다. 그렇다면 이 Layer의 파라미터 수는 몇개일까요?

9-8 파라미터의 갯수는 공식은 필터사이즈 x 입력depth x 필터갯수 입니다. 그렇다면 (11*11*3)*95 = 35,000개가 됩니다.

9-9 그렇다면 두번째 레이어를 살펴볼까요? 두번째는 풀링 레이어 입니다. Alexnet에서는 maxpooling을 사용합니다 output volume 사이즈는 어떨까요?

9-10 앞의 공식을 적용하면 27x27x96이 됩니다 그렇다면 파라미터의 갯수는 몇개일까요?

9-11 0개입니다. 당연하겠죠? pooling layer는 단순 downsampling로 파라미터가 없습니다.

9-12 이렇게 conv와 pooling가 반복되어 AlexNet을 구성합니다

9-13 AlexNet의 전체구조입니다. 그림에 input 사이즈가 224라고 나와있지만 실제로는 227입니다. 총 5개의 conv와

3개의 max pool 2개의 FC로 구성됩니다.

9-14 AlexNet을 디테일하게 살펴보면 ReLU를 처음 사용하였습니다. 그리고 Norm으로 local response normalization사용하였는데 현재는 사용하지 않습니다. 많은 augmentation을 사용하였으며 0.5의 dropout을 사용했습니다. 학습률을 0.01에서 검증 auc가 평평해지면 10으로 나누어 추가적인 학습을 진행했습니다. 그외는 표에 나와있는 것과 같습니다.

9-15 AlexNex이 개발되었을 시대에는 컴퓨팅파워가 낮아 3GB의 GPU밖에 없어 AlexNet으로 ImageNet을 학습시킬 수 없었습니다. 그래서 model parallel을 통해 두개의 GPU을 연결해 병렬로 처리했습니다. 그래서 자세히 그림을

보시며 conv1에서 depth가 96이아니라 48입니다.

9-16 CONV1, CONV2, CONV4, CONV5의 경우 같은 GPU끼리 feature maps을 연결하고있으며

9-17 CONV3, FC6, FC7, FC8의 경우는 2개의 GPU가 모든 feature maps을 연결하고있습니다.

9-19 앞서 본 AlexNet은 12년도 ImageNet에서 우승했습니다. 그 뒤에 이어서 ZFNet이 13년도 ImageNet우승을

차지했습니다.

9-20 ZFNet 은 AlexNet과 유사하지만 11x11 with stride4의 필터를 7x7 with stride 2로 바꾸었으며 기존의

CONV3, 4, 5의 필터갯수를 384, 384, 256에서 512, 1024, 512로 바꾸었습니다.

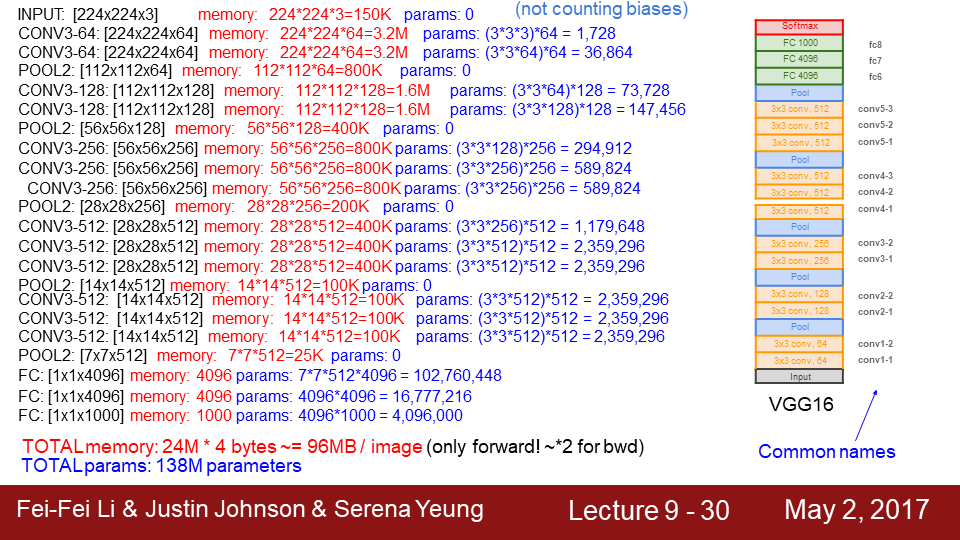

9-21 다음은 14년도 ImageNet 우승작을보겠습니다. 먼저 ImageNet 2등과 localization대회에서 2등을 차지한 VGGNet의 구조를 알아보겠습니다. localization대회란 기본적으로 "이미지에 고양이가 있는지?" 를 분류하는 것 뿐만 아니라 정확히 고양이가 어디에 있는지 네모박스를 그리는 것입니다.

9-22 VGGNet의 특징은 더 깊어지고 더 작은 필터를 사용했다는것입니다. 이웃픽셀을 포함할 수 있는 가장작은 필터인 3x3 필터를 사용했습니다. 그리고 작은 필터를 유지하고 주기적으로 pooling을 수해했습니다.

9-23 왜 작은 필터를 사용할까요? 우선 필터의 크기가 작으면 파라미터의 수가 적고 depth를 더 키울 수 있습니다.

9-24 3x3 with stride1 CONV를 3번 쌓게 되면 effective receptive field는 무엇일까요?

9-25 정답은 7x7입니다. 왜 이렇게 되는지 살펴보겠습니다.

보충 첫 번째 layer에서 하나의 픽셀은 CONV를 통해 3x3의 정보를 가지게 됩니다 두 번째 레이어에서 하나의 픽셀은 3x3의 정보를 가진 상태에서 또다시 3x3의 CONV를 통해 5x5의 정보를 가집니다. 이런식으로 3x3의 CONV를 3번 쌓게되면 7x7의 effective receptive field 가지게 됩니다.

9-26 effective receptive field을 이해했다면 왜 이렇게 할까요? 그 이유는 좀 더 깊은층을 쌓을 수 있으며 비선형함수를 더 쌓기때문에 표현이 자유로워 집니다. 또, 파라미터의 갯수가 줄어듭니다.

앞서 파라미터의 갯수는 필터의크기 x 입력의 depth x 필터의 갯수라고 했죠? 그렇다면 3x3xCxC가 세번 쌓이기 때문에 3*(3*3*C*C) = 27*C*C가 됩니다. 7x7의 파라미터 갯수는 어떻게 될까요? 7*7*C*C = 49*C*C로 두배가까이 차이가 납니다. 왜 입력의 depth와 필터의 갯수가 같아야하나? 왜 같은C인가? 의문이 있다면 같은 입력과 출력을 가져야만 effective receptive field를 가질 수 있기때문입니다. 이부분은 다른 포스팅을 통해 한번 더 다루겠습니다.

9-27 VGGNet의 전체 구조입니다.

9-28 Total memory는 한번의 forward pass시 필요한 메모리를 계산한것입니다. 각노드가 4bites의 메모리를 차지하기 때문에 약 100mb입니다. 전체 메모리가 5gb라면 이미지 하나당 100mb이므로 50장밖에 처리할 수 없습니다.

그리고 전체 파라미터의 개수는 1억3800만개 이며 AlexNet경우에는 6000만개 였습니다.

9-29 앞부분에서 메모리가 많이 들며 FC에서 파라미터 개수가 많습니다 그래서 최근에는 FC를 없애는 추세입니다.

9-30 CONV를 지칭하는 방법이며 기억하시면 논문을 읽는데 도움이 될 것 같습니다.

9-31 VGG의 마지막 FC-layer FC7은 아주 좋은 feature representation 특징 추출이 잘되며 다른 task에도 일반화가 뛰어납니다. 학습절차는 AlexNet과 비슷하며 LRN은 사용하지 않았고 최종결과 중 BEST를 앙상블 했습니다.

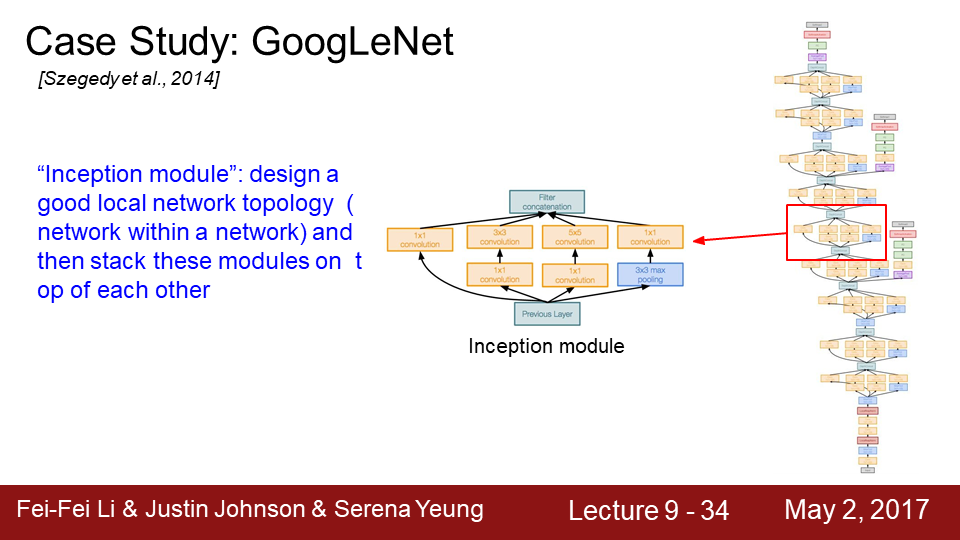

9-32 이제 14년도 ImageNet우승 모델인 GooGleNet을 살펴보겠습니다.

9-33 GooGleNet은 효율적인 계산력을 가진 깊은 모델입니다. 총 22개의 layer을 가지고 효율적은 Inception이라는 모듈을 가집니다. FC layer은 없으며(많은 파라미터 때문), AlexNet보다 12배 적은 500만개의 파라미터를 가집니다.

9-34 인셉션 모듈은 network 안에 network 즉 good local network topology를 만들다는 생각에서 출발했습니다.

9-35 Local network 를 인셉션 모듈이라 하는데 인셉션 모듈 내에는 동일한 입력은 받는 서로다른 다양한 필터들이

병렬로 존재합니다. 1x1 / 3x3 / 5x5 CONV에 Pooling도 있습니다. 여기에서는3x3 pooling이죠 각 레이어에서 각각의

출력 값들이 나오는데 그 출력들을 모두 Depth 방향으로 합칩니다(concatenate). 그렇게 합치면 하나의 tensor로 출력이 결정되고 이 하나의 출력을 다음 레이어로 전달하는 것입니다.

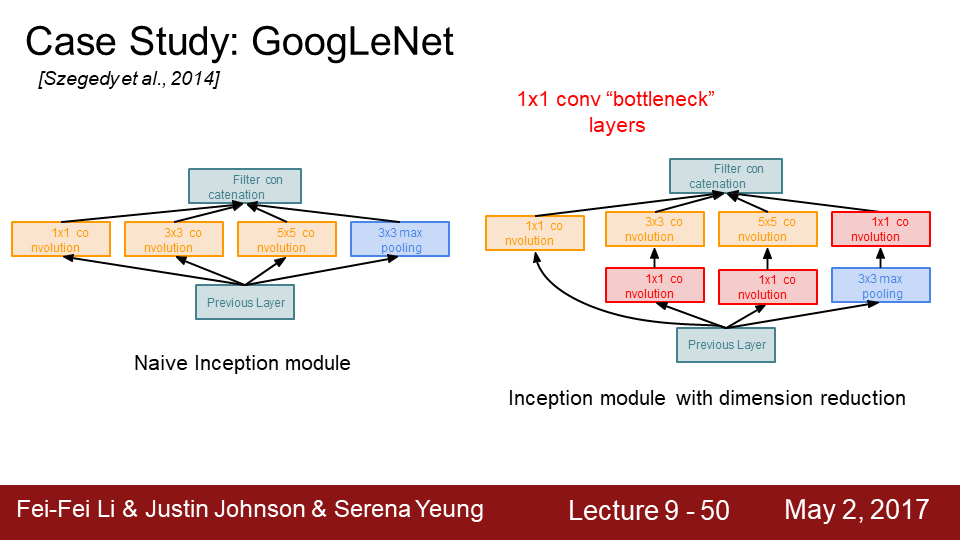

9-36 지금까지는 다양한 연산을 수행하고 이를 하나로 합쳐준다는아주 단순한 방식(naive way)을 살펴봤습니다. 그렇다면 이 network의 문제점은 뭘까요?

9-37 문제는 바로 계산 비용에 있습니다.

9-38 1x1 conv with 128 filters의 output 사이즈는 몇일까요?

9-39 28x28x128입니다.

9-40 다른 filter의 output 사이즈는 어떻게될까요?

9-41 input 사이즈의 크기에서 필터의 갯수에 따라 output사이즈를 가집니다.

9-42 모든 필터를 합쳤을 때 output사이즈는 어떨까요?

9-43 depth 기준으로 합친다고 했으니 28x28x672입니다.

9-44 이 레이어들의 계산량을 한번 살펴봅시다 첫 번째 예시로 1 x 1 conv를 살펴봅시다. 1 x 1 conv는각 픽셀마다

1 x 1 x 256 개의 내적연산을 수행합니다. 따라서 픽셀 당 256번의 곱셈 연산이 수행되는 것이죠(Conv Ops:맨 뒤의 256) 그리고 픽셀이 총 28 x 28 이므로처음 "28 x 28" 이 여기에 해당합니다. 그리고 이런 연산을 수행하는 필터가 총 128개 있으므로 1 x 1 conv에서의 전체 연산량은28 x 28 x 128 x 256 입니다. 똑같이 나머지 레이어를 계산하면 8억5천4백만 flops가 됩니다. 매우 큽니다.

9-45 또한 pooling layer 또한 문제가 되는데 풀pooling layer 입력은 depth를 그대로 가져오기때문에 무조건 입력의 depth보다 커질 수 밖에 없습니다.

9-46 이 엄청난 계산량을 해결해주기 위해 bottleneck layer가 나왔습니다. bottleneck layer는 feature의 depth를

줄여주는데 자세히 살펴보겠습니다.

9-47 1x1 conv를 다시 한번 살펴봅시다.

9-48 1x1 conv는 각spatial location에서만 내적을 수행합니다. 그러면서 depth만 줄일 수 있습니다. 입력의 depth를더 낮은 차원으로 projection 하는 것입니다. Input feature map들 간의선형결합(linear combination) 이라고 할 수 있습니다. 주요 아이디어는 바로 입력의 depth를 줄이는 것입니다.

9-49 왼쪽 그림은 초기의 인셉션 모듈이고 오른쪽은 인셉션 모듈에 bottleneck layer 적용한 모습입니다.

9-50 3x3, 5x5 CONV 전에 bottleneck layer가 추가되었고 3X3 POOL 뒤에 bottleneck layer가 추가되었습니다.

9-51 자 그럼 필터들의 output사이즈와 계산량을 구해보겠습니다. 결론을 말씀드리면 초기의 인셉션 모듈보다 두배 이상 계산량이 절감되었음을 볼 수 있습니다.

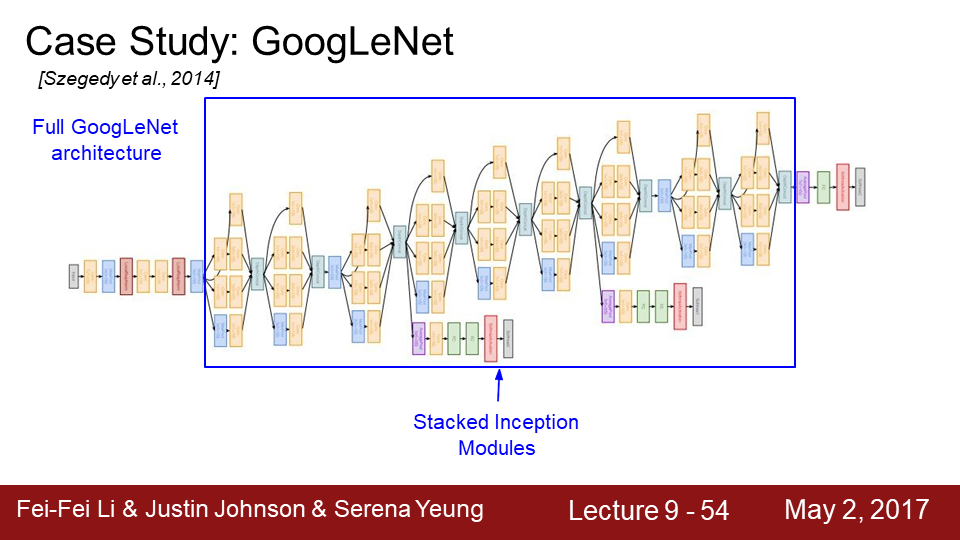

9-52 이러한 인셉션 모듈을 쌓아 만든 모델이 GoogLeNet입니다.

9-53 전체 GoogLeNet을 알아보겠습니다. 시작은 기존의 models과 비슷하게 CONV- POOL 구조를 가집니다.

9-54 그다음 중간에 인셉션 모듈을 쌓습니다.

9-55 마지막에 Classifier output이 있습니다.

9-56 GoogLeNet에서는 계산량이 많은 FC-layer를 대부분 걷어냈고 파라미터가 줄어들어도 모델이 잘 동작함을

확인했습니다.

9-57 그리고 여기 보시면 추가적인 줄기가 뻗어있는데이들은 보조분류기(auxiliary classifier) 입니다.이것들은 단지 작은 미니 네트워크들입니다. Average pooling과 1x1 conv가 있고 FC-layer도 몇개 붙습니다.

그리고 SoftMax로 1000개의 ImageNet class를 구분합니다. 그리고 실제로 이 곳에서도ImageNet trainset loss를

계산합니다. 네트워크의 끝에서 뿐만 아니라 이 두 곳에서도 Loss를계산하는 이유는 네트워크가 깊기 때문입니다.

보조분류기를 중간 레이어에 달아주면 추가적인 그레디언트를 얻을 수 있고, 따라서 중간 레이어의 학습을 도울 수 있습니다.

9-58 전체 아키텍쳐의 모습입니다.가중치를 가진 레이어는 총 22개입니다. 각 Inception Modul 은 1x1/3x3/5x5 conv layer를병렬적으로 가지고있습니다.

9-59 지금까지 14년도 ImageNet 우승 모델인 GoogLeNet을 살펴봤습니다.

9-60 다음은 15년도 ImageNet모델인 ResNet을 살펴보겠습니다. 깊이의 혁명이라 불릴 정도로 ResNet모델의 depth는 기존의 모델보다 매우 깊습니다.

9-61 ResNet은 residual connections을 사용한 매우 깊은 모델입니다. 이제 ResNet에 대해 알아보겠습니다.

9-62 만약에 CONV를 깊게 쌓는다면 어떨까요? 예를들어 VGGNet의 CONV를 엄청 늘리면 성능이 어떻게될까요?

9-63 그림은 20레이어와/56의 레이어의 모델 성능을 나타냅니다. 오른쪽의 test error의 경우는 56레이어가 20레이어보다 안좋습니다. 더 깊은 네트워크가 안좋을 수 있구나 생각할 수 있습니다.

9-64 그러나 training error를 보면 조금 이상합니다. 깊은 네트워크가 있다면 당연히 엄청나게 많은 파라미터로 인해

오버피팅 되겠구나 예상할텐데 training error또한 20레이어보다 안좋고 이는 오버피팅 때문이 아니였습니다.

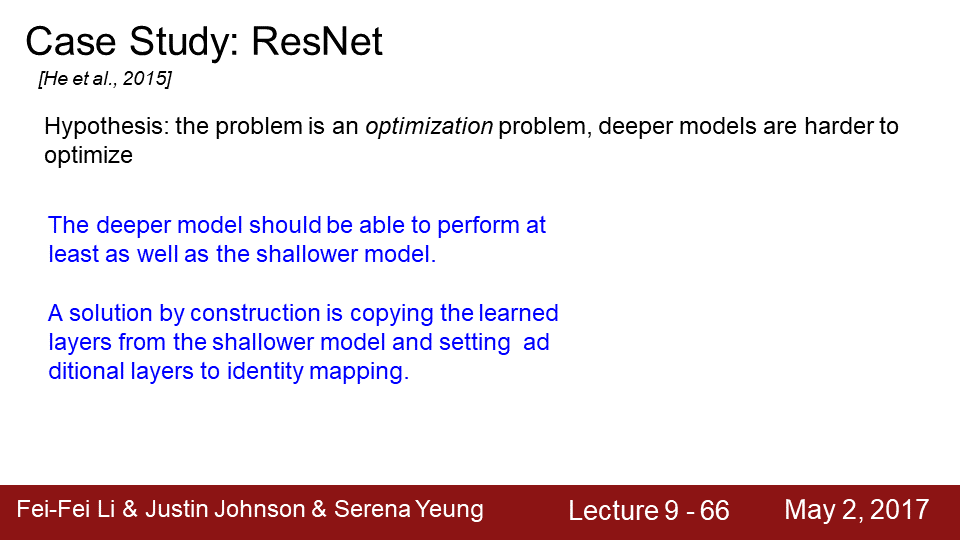

9-65 Resnet저자들의 가설은 모델학습시 최적화에 문제가 있다고 생각하고 모델이 깊어질수록 최적화가 어렵다고

생각했습니다.

9-66 그들은 "모델이 더 깊다면 적어도 더 얕은 모델만큼은성능이 나와야 하지 않은지"라고 추론했습니다. 가령 이런

해결책을 생각해 볼 수 있습니다. 우선 더 얕은 모델의가중치를 깊은 모델의 일부 레이어에 복사합니다. 그리고 나머지

레이어는 identity mapping을 하는 것이죠(input을 output으로 그냥 내보냄) 이렇게 구성하면 shallower layer 만큼의

성능을 나와야겠죠 Deeper Model의 학습이 제대로 안되더라도적어도 Shallow Model 만큼의 성능은 보장됩니다.

그렇다면 이 motivation을 우리가 만들 모델에 녹이려면어떻게 모델 아키첵쳐를 디자인해야할까요?

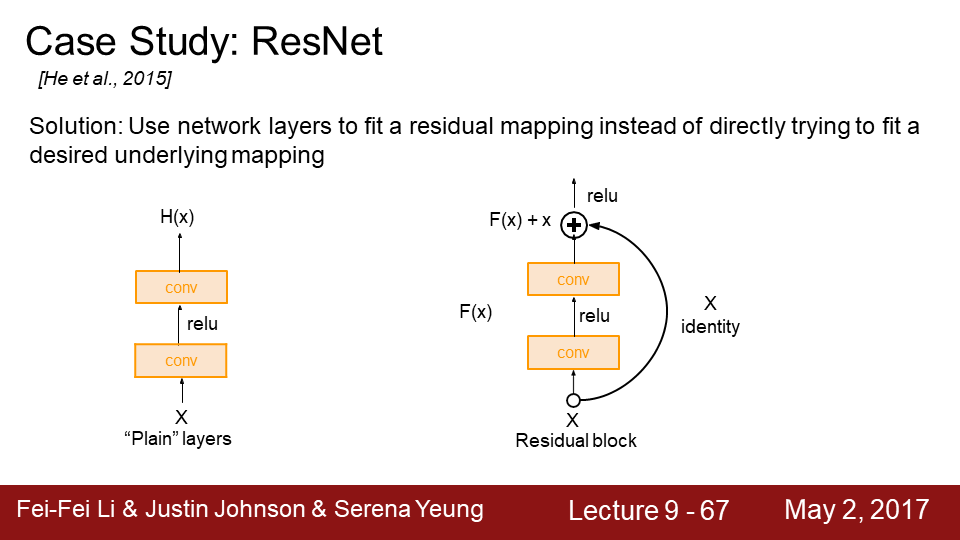

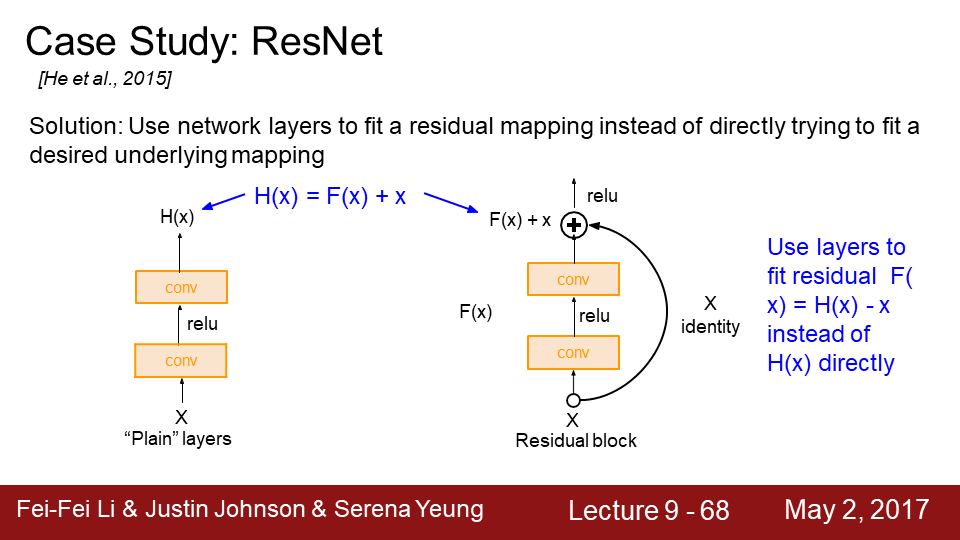

9-67 그들의 아이디어는 레이어를 단순하게 쌓지 않는 것입니다.

9-68 레이어가 직접 "H(x)"를 학습하기 보다이런 식으로 "H(x) - x" 를 학습할 수 있도록 만들어줍니다. 이를 위해서

Skip Connection을 도입하게 됩니다.오른쪽의 고리모양 보이시죠 오른쪽의 Skip Connection은 가중치가 없으며 입력을 identity mapping으로 그대로 출력단으로 내보냅니다. 그러면 실제 레이어는 변화량(delta) 만 학습하면 됩니다.

입력 X에 대한 잔차(residual) 이라고 할 수 있죠Direct mapping 대신 Residual mapping을 하도록이런 식으로 블럭을

쌓는 것이죠 최종 출력 값은 "input X + 변화량(Residual)" 입니다. 이 방법을 사용하면 학습이 더 쉬워집니다.

가령 Input = output 이어야 하는 상황이라면 레이어의 출력인 F(x)가 0 이어야 하므로(residual = 0) 모든 가중치를

0으로 만들어주면 그만입니다. 결론적으로 H(x)의 값을 훈련시키기 어려우니 x+f(x)를 통해 x의 변화량을 측정하는 것이

더 효율적이다라는 이야기입니다. 그렇다면 이 아이디어가 아까 위에 나온 아디디어 처럼 Shallow Model 만큼의 성능은 보장될 수 있습니다. 만약 그전 Shallow Model layer의 가중치를 업로드하고 그전보다 성능이 안좋다면 나머지 layer에 가중치가 0이 되어 Shallow Model의 성능은 나온다는 이야기입니다.

9-69 여기 전체 ResNet 아키텍쳐를 보실 수 있습니다. 하나의 Residual blocks는 두 개의 3x3 conv layers로이루어져

있습니다. 이렇게 구성해야 잘 동작하는 것으로 알려져있습니다.

9-70 그리고 주기적으로 필터를 두배 씩 늘리고stride 2를 이용하여 Downsampling을 수행합니다.

9-71 시작은 CONV layer로 시작합니다.

9-72 그리고 네트워크의 초반에는 Conv Layer가 추가적으로 붙고네트워크의 끝에는 FC-Layer가 없습니다. 대신

Global Average Pooling Layer 를 사용합니다.GAP는 하나의 Map 전체를 Average Pooling 합니다.

9-73 전체 depth에 따라 34, 50, 101, 152모델이 있습니다.

9-74 ResNet의 경우 모델 Depth가50 이상일 때 Bottleneck Layers를 도입합니다. 이는 GoogLeNet에서 사용한 방법과 유사합니다. Bottleneck Layer는 1x1 conv를 도입하여초기 필터의 depth를 줄여줍니다.

9-75 가령 입력이 28x28x256 일때 1x1 conv를 적용하면 depth가줄어들어서 28x28x64 가 됩니다. 이로인해

3 x 3 conv의 계산량이 줄어듭니다. 그리고 뒤에 다시 1x1 conv를 추가해서 Depth를 다시 256으로 늘립니다.

Deeper ResNet은 이런 구조를 취합니다.

9-76 ResNet의 training 방법은 우선 CONV 이후 Batch Normalization을 사용했으며 Xavier/2 인 가중치를 사용했으며 나머지는 그림과 같이 적용했습니다.

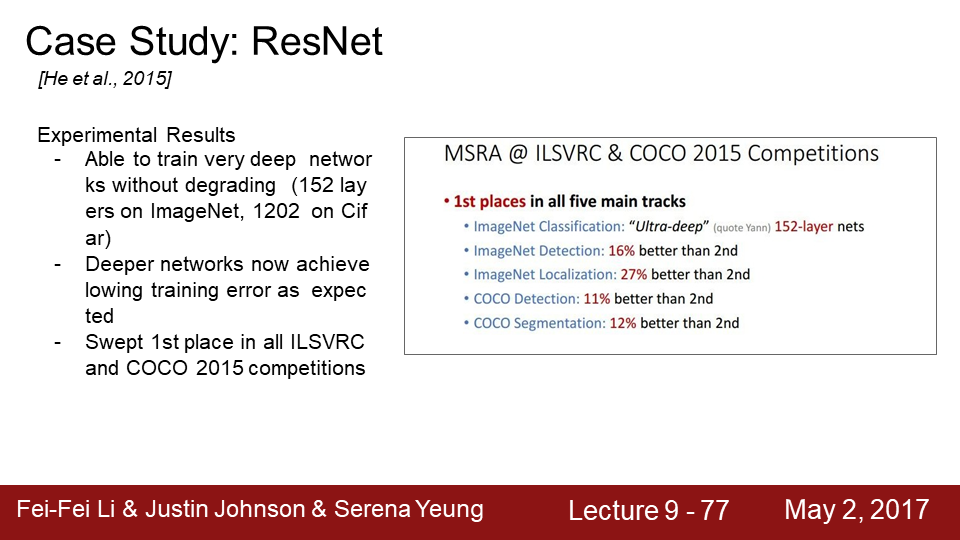

9-77 ResNet은 다른모델과 압도적인 차이를 벌리며 모든 대회에서 우승했습니다.

9-78 그리고 최초로 ImageNet에서 인간을 이긴 모델이됩니다.

9-79 이시점에서 ImageNet대회는 마감하게됩니다.

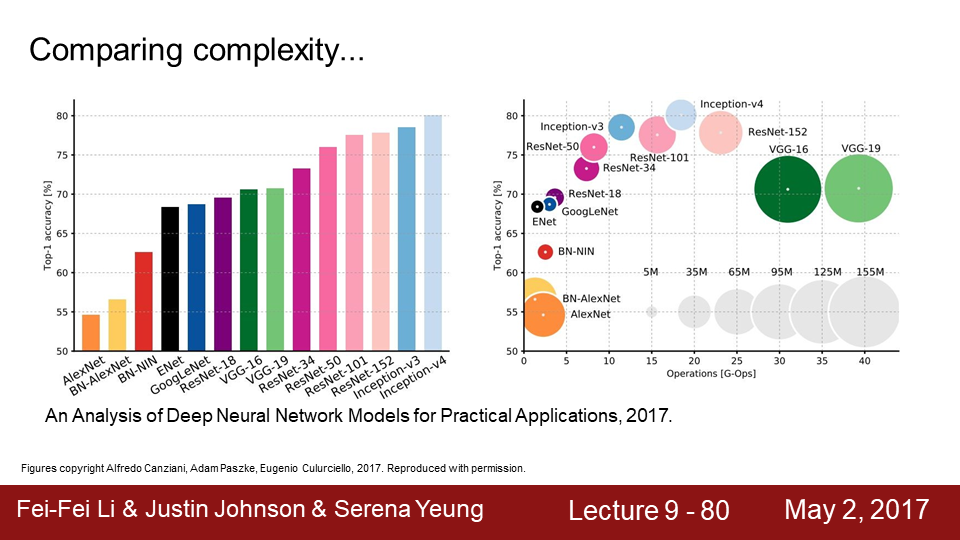

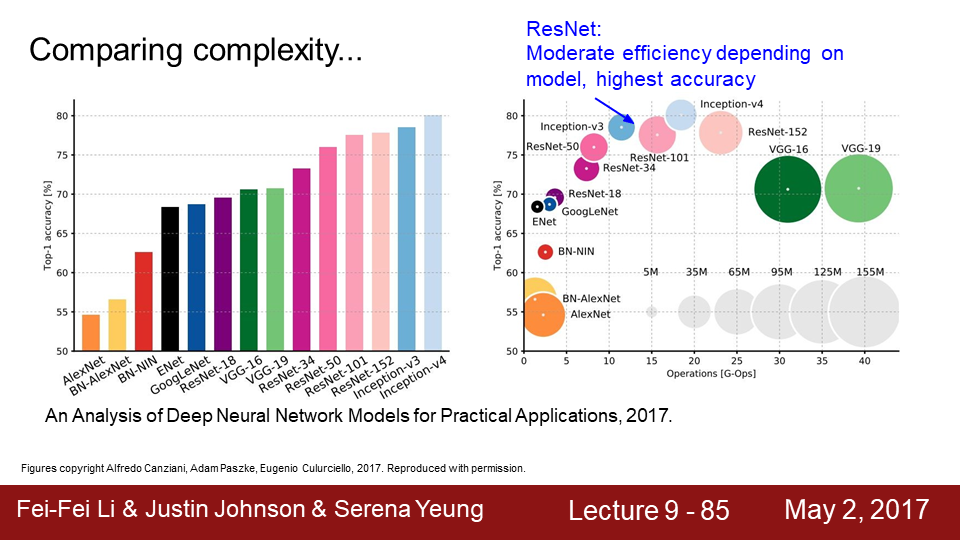

9-80 자 그럼 모델 별 complexity를 빠르게 한번 살펴보겠습니다. 왼쪽 그래프는 모델의 성능 별로 정렬해 보았습니다 .Top-1 Accuracy가 기준이고 높을수록 좋은 모델입니다. 자 이제는 오른쪽 그래프를 살펴봅시다. 연산량과 메모리가 추가되었습니다. Y축은 top-1 Accuracy이고 높을수록 좋습니다. X축은 연산량을 나타냅니다. 오른쪽으로 갈수록 연산량이 많습니다.원의 크기는 메모리 사용량입니다. 원이 클수록 덩치가 큰 모델이죠.

9-81 거의 모두 우리가 지금까지 배운 모델이거나 조금 변형된모델들 입니다. 가령 GoogLe-inception을 보시면이

모델은 버전별로 V2, V3 등이 있는데 가장 좋은 모델은 바로 여기V4 입니다. ResNet + Inception 모델입니다.

9-82 VGGNet의 경우는 메모리도 크고 연산량도 많이 최근에는 사용하지 않습니다.

9-83 GoogLeNet이 가장 효율적인 네트워크입니다. x축에서거의 왼쪽에 있죠 뿐만 아니라 메모리 사용도 적습니다.

9-84 AlexNet의 경우 연산량은 적으나 메모리도 크고 정확도 또한 낮습니다 VGG와 마찬가지로 사용하지 않습니다.

9-85 ResNet으 적당한 연산량과 메모리를 가지며 높은 정확도를 나타내 최근에도 사용되며 많이 개발되고 있는 모델입니다.

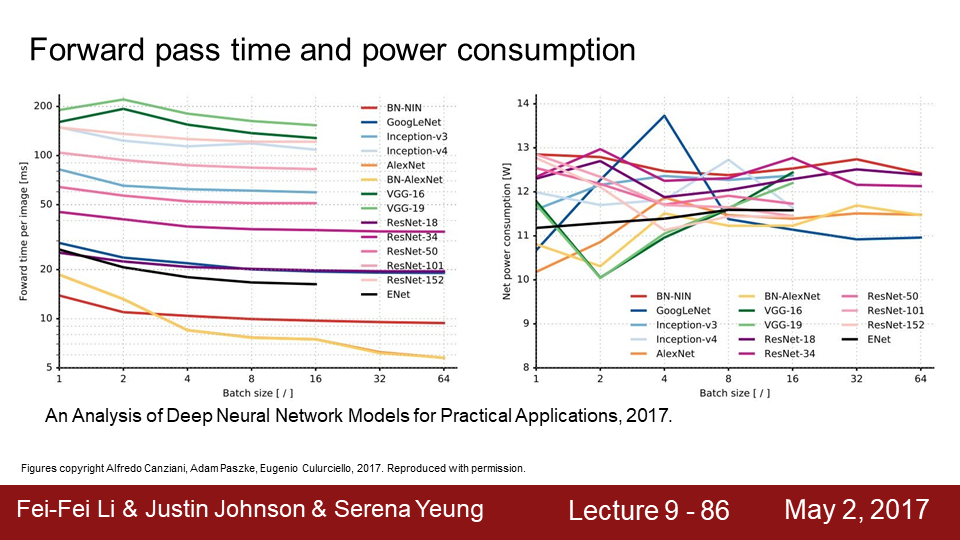

9-86 왼쪽 그래프는 forward pass 시간입니다. 단위는 ms 인데VGG가 제일 오래걸립니다. 200ms으로 초당 5정도 처리할 수 있겠군요

9-87 이제 다른 CNN모델 구조에 대해 보겠습니다.

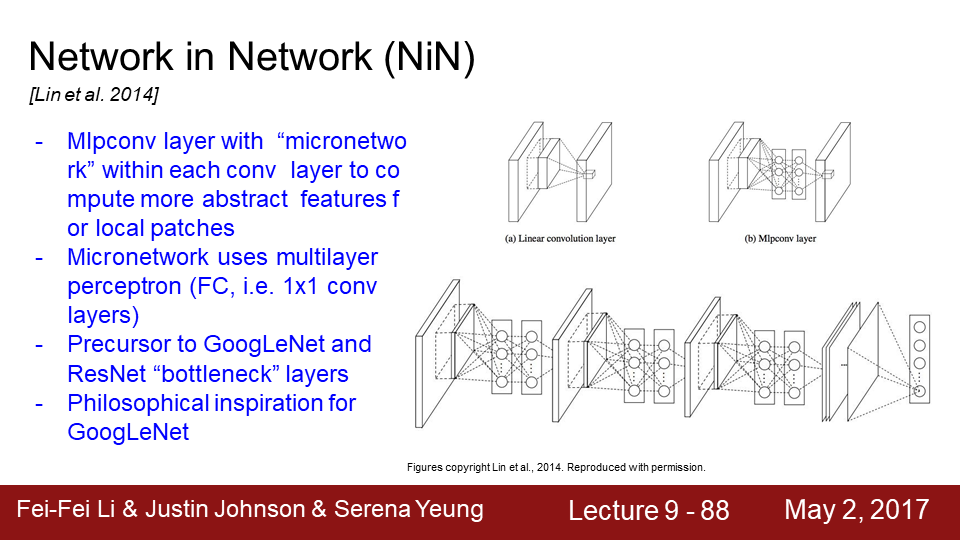

9-88 Network in Network 입니다.2014년에 나온 논문입니다. Network in Network의 기본 아이디어는 네트워크 안에 작은 네트워크를 삽입하는 것이죠 각 Conv layer 안에 MLP(Multi-Layer Perceptron)를 쌓습니다. FC-Layer 몇 개를 쌓는 것이죠맨 처음에는 기존의 Conv Layer가 있고 FC-Layer를 통해 abstract features를 잘 뽑을수 있도록 합니다 단순히 conv filter만 사용하지 말고, 조금 더 복잡한 계층을만들어서 activation map을 얻어보자는 아이디어입니다. NIN에서는 기본적으로는 FC-Layer를 사용합니다. 이를 1x1 conv layer 라고도 합니다. Network in Network는 GoogLeNet과 ResNet보다 먼저 Bottleneck 개념을 정립했기 때문에 아주 의미있는 아이디어입니다. 또한 GoogLeNet은 NIN와 구조는 조금 다르지만 NIN의 "철학적인 영감" 을 받았습니다.

9-89 2016년 ResNet의 저자들은 ResNet의 블록 디자인을 향상시킨 논문을 발표했습니다. 이 논문에서는 ResNet block path를 조절하였습니다. 새로운 구조는 direct path를 늘려서 정보들이 앞으로 더욱 더 잘 전달되고 Backprob도 더 잘 될 수 있게 개선했습니다. 이 새로운 Block 구조 덕분에 더 좋은 성능을 얻을 수 있었습니다.

9-90 Wide Residual Networks입니다. 기존의 ResNet 논문은 깊게 쌓는 것에 열중했지만 사실 중요한 것은 depth가 아닌 residual 이라고 주장했습니다. Residual Connection이 있다면 네트워크가 굳이 더 깊어질 필요가 없다고 주장했습니다. 그래서 그들은 residual block 을 더 넓게 만들었습니다. 즉 conv layer의 필터를 더 많이 추가했습니다. 가령 기존의 ResNet에는 Block 당 F개의 filter만 있었다면 대신에 F * K 개의 필터로 구성했습니다. 각 레이어를 넓게 구성했더니 50 레이어만 있어도 152 레이어의 기존 ResNet보다 성능이 좋다는 것을 입증했습니다. 그리고 네트워크의 Depth 대신에 filter의 갯수를 늘리면 추가적인 이점이 있는데, 계산 효율이 증가합니다. 왜냐하면 병렬화가 더 잘되기 때문입니다. 네트워크의 Depth를 늘리는 것은 sequential한 증가이기 때문에 conv의 필터를 늘리는(width) 편이 더 효율적입니다.

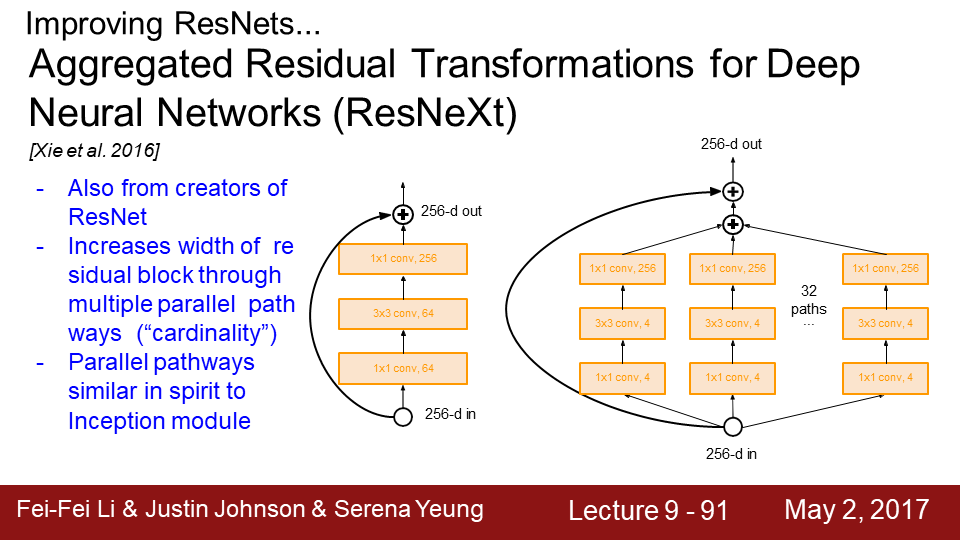

9-91 그리고 비슷한 시점에 등장한 또 하나의 논문이 있습니다. 바로 ResNeXt 입니다. 이 논문 또 ResNet의 저자의 논문입니다.계속해서 ResNet 구조를 밀고 있습니다. 여기에서도 계속 residual block의 width를 파고듭니다. filter의 수를 늘리는 것이죠 각 Residual block 내에 "다중 병렬 경로" 추가합니다. 이들은 pathways의 총 합을 cardinality라고 불렀습니다. 하나의 bottleneck ResNet block은 비교적 작지만 이런 얇은 blocks을 병렬로 여러개 묶었습니다. 또한 여러 Layers를 병렬로 묶어준다는 점에서Inception Module과도 연관있습니다.

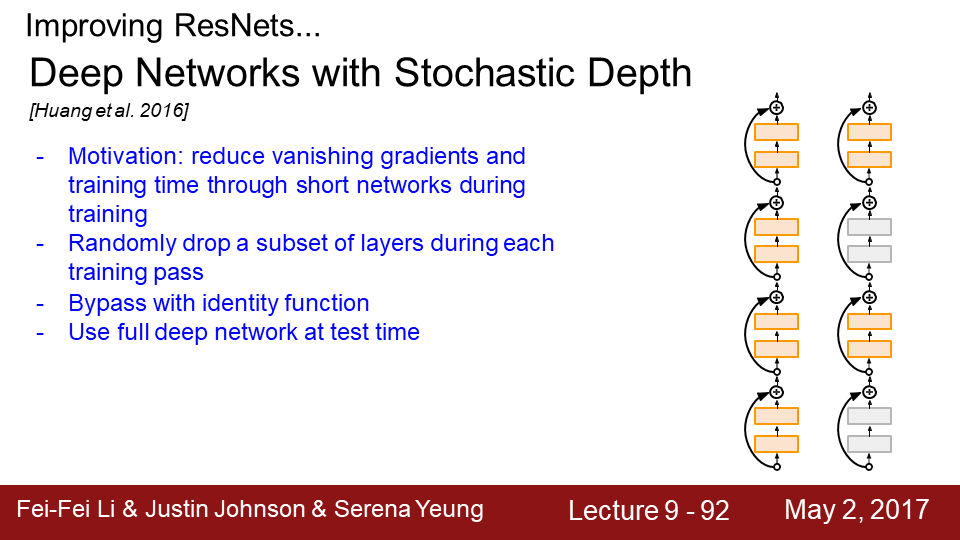

9-92 Stochastic Depth 이라는 논문이 있습니다. 주제는 Depth 이죠 네트워크가 깊어지면 깊어질수록 Vanishing gradient 문제가 발생합니다. 깊은 네트워크에서는 그레디언트를 뒤로 전달할수록점점 그레디언트가 작아지는 문제가 있습니다. 기본 아이디어는 Train time에 레이어의 일부를 제거합니다.short network면 트레이닝이 더 잘 될 수 있기 때문입니다.일부 네트워크를 골라서 identity connection으로 만들어버립니다. 이렇게 shorter network를 만들어서 Train하면그레디언트가 더 잘 전달될 수 있겠죠 아주 효율적인 방법이 될 수 있습니다. Dropout과 유사합니다. 그리고 Test time에서는 full deep network를 사용합니다.

9-93 지금까지 소개시켜 드린 방법들은 ResNet 아키텍쳐를 개선하고자 노력했습니다. "Beyond ResNet"을 지향하는 방법들도 있습니다. Non-ResNets 중에도 ResNet과 견줄만한 성능의 모델들이 있습니다. 그 중 하나는 FractalNet 입니다. 아주 최근에 나왔습니다.그들은 residual connection이 쓸모없다고 주장합니다. FractalNet 아키텍쳐에서는 residual connection이 전혀 없습니다. 그들은 shallow/deep network의 정보 모두를 잘 전달하는 것이 중요하다고 생각했습니다. FractalNet에서는 shllow/deep 경로를 출력에 모두 연결합니다. FractalNet에는 다양한 경로가 존재하지만 Train time에는Dropout처럼 일부 경로만을 이용해서 Train 합니다. 그리고 Test time에는 full network를 사용합니다. 그들은 FractalNet의 좋은 성능을 입증했습니다.

9-94 DenseNet에는 Dense Block 이란 것이 있습니다. 여기 보시면 한 레이어가 그 레이어 하위의모든 레이어와 연결되어 있습니다. Network의 입력이미지가 모든 Layer의 입력으로 들어갑니다. 그리고 모든 레이어의 출력이 각 레이어의 출력과 Concat 됩니다. 그리고 이 값이 각 Conv layer의 입력으로 들어갑니다. 이 과정에서 dimention을 줄여주는 과정이 포함됩니다.이들은 Dense Connection이 Vanishing gradient 문제를 완화시킬 수 있다고 주장합니다. 그리고 Dense connection은 Feature를 더 잘 전달하고더 잘 사용할 수 있게 해줍니다. 각 레이어의 출력이 다른 레이어에서도여러번 사용될 수 있기 때문입니다.

9-95 "squeeze layer"는 1x1 필터들로 구성되고, 이 출력 값이 1x1/3x3 필터들로 구성되는 "expand layer"의 입력이 됩니다. SqueezeNet는 ImageNet에서 AlexNet 만큼의Accuracy를 보이지만 파라미터는 50배 더 적었습니다. 그리고 SqueezeNet을 더 압축하면 AlexNet보다500배 더 작아지게 됩니다. SqueezeNet의 용량은 0.5Mb 밖에 안됩니다

9-96,97 지금까지 CNN의 구조에 대해 알아봤습니다. 현재 Efficientnet 시리즈 등 많은 모델이 나왔으니 논문을 읽어보시면 도움이 될 것 같습니다.

'데이터분석 > vision' 카테고리의 다른 글

| VGGNet using keras (0) | 2019.11.07 |

|---|---|

| LRN(Local Response Normalization) 이란 무엇인가?(feat. AlexNet) (0) | 2019.11.07 |

| AlexNet using keras (0) | 2019.11.06 |

| LeNet-5 using keras (0) | 2019.10.30 |

| Lecture 7: Training Neural Networks, part I (0) | 2019.10.17 |